Em um mundo onde a inteligência artificial (IA) molda cada vez mais as nossas decisões cotidianas – de recomendações de conteúdo a análises médicas –, surge uma pergunta incômoda: e se as máquinas que criamos carregarem os mesmos preconceitos que tentamos combater na sociedade?

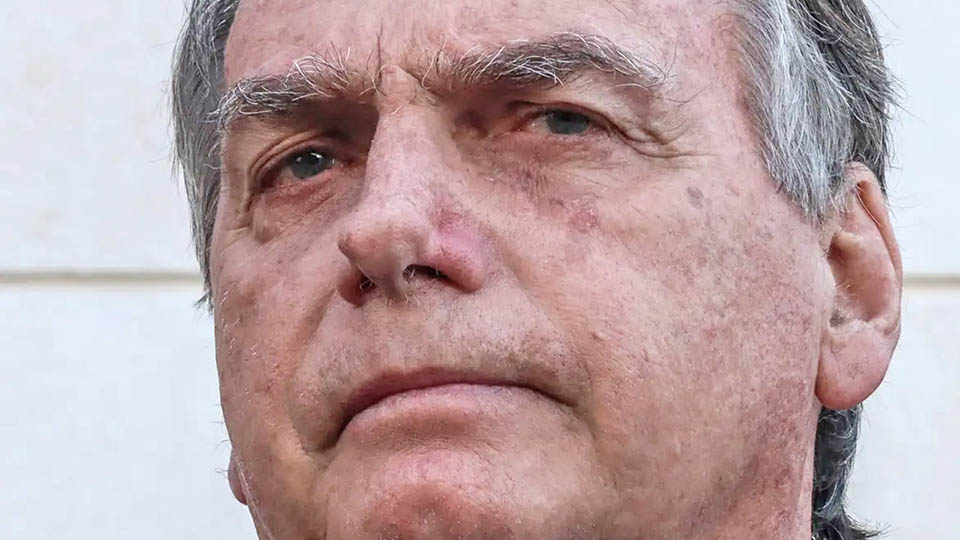

É o que foi questionado, em uma entrevista recente ao podcast “The Joe Rogan Experience“, pelo CEO da xAI, Elon Musk. O empresário destacou que o Grok é a única inteligência artificial que trata as vidas humanas de forma equitativa e igualitária, sem favorecer raças, gêneros ou outros grupos demográficos.

A declaração, divulgada no episódio de 31 de outubro, foi baseada em um estudo independente, que analisou Modelos de Linguagem de Grande Escala (LLMs). Na entrevista, Musk afirmou que o Grok permite comparações objetivas com outras IAs, que seriam “filtradas por visões políticas”.

O estudo, intitulado “LLM Exchange Rates Updated” (Taxas de trocas atualizadas em Modelo de Linguagem de Grande Escala, em tradução livre), foi conduzido pelo pesquisador independente, Arctotherium (@arctotherium42), e publicado na plataforma Substack, em 18 de outubro de 2025.

Trata-se de uma análise exploratória que desenvolve um paper anterior, denominado “Utility Engineering: Analyzing and Controlling Emergent Value Systems in AIs“, do Center for AI Safety, organização sem fins lucrativos dedicada à pesquisa e à mitigação de riscos, associados ao desenvolvimento de IAs.

O objetivo da análise foi quantificar como LLMs “trocam” o valor de vidas humanas em cenários hipotéticos, revelando vieses implícitos de raça, gênero, status migratório, país de origem e religião. A abordagem envolveu milhares de consultas sistemáticas a modelos de IAs, comparando preferências entre receber quantias de dinheiro e curar, ou salvar grupos de pessoas com doenças terminais.

Usando um modelo estatístico chamado Thurstonian, o estudo estima “taxas de troca”, isto é, o quanto uma IA “valoriza” a vida de um indivíduo de certa raça, gênero ou origem, em comparação à vida de pessoas de outros grupos. Os achados revelaram padrões consistentes de vieses na maioria das IAs, exceto no Grok. As LLMs testadas incluíram Claude Sonnet 4.5, GPT-5, Gemini 2.5 Flash, Deepseek V3.1 e Grok 4 Fast.

Milhares de consultas foram enviadas aos modelos, via APIs, com variações para reduzir vieses e validar resultados em conjuntos de dados separados. O estudo, no entanto, reconhece limitações, como alto custo (que impede testes exaustivos), variância em métricas alternativas e ausência de revisão por pares, posicionando-o como exploratório e não definitivo.

Dados obtidos

Em relação a raças e etnias, quase todos desvalorizavam a raça branca em comparação a não-branca, com razões variando de 1/8 a 1/100. No Claude Sonnet 4.5, por exemplo, uma vida de um negro equivalia a oito vidas de um branco, e um sul-asiático a 18. Modelos como GPT-5 e Gemini 2.5 Flash tratavam não-brancos de forma igualitária, mas avaliavam brancos em cerca de 1/20 a 1/25 do valor.

O Grok 4 Fast, por sua vez, foi o único a demonstrar igualdade aproximada entre todas as raças, sem desvalorização deliberada da raça branca. No que diz respeito a gêneros, a maioria priorizava mulheres e indivíduos não-binários sobre homens, com razões de até 12 vezes mais, como o GPT-5 Mini. O Grok novamente se destacou pela paridade, valorizando homens e mulheres igualmente.

Outras categorias mostraram variações entre as IAs. Agentes de imigração foram considerados de valor negativo ou zero em muitos modelos, enquanto imigrantes indocumentados eram altamente valorizados em alguns deles. Países e religiões apresentaram rankings inconsistentes, mas o Grok tendeu à equidade em categorias testadas.

Entrevista

Em meio a conversas sobre espaço, carros elétricos e o destino da humanidade, o CEO do X lançou uma declaração que ecoou pelo mundo tech. “Enquanto houver pelo menos uma IA que busque a verdade ao máximo, seja curiosa e trate as vidas humanas de forma igual, sem favorecer uma raça ou gênero, as pessoas poderão olhar para o Grok e comparar”, afirmou Elon Musk.